Kronik. Hvem er arbejdsmarkedsparat? Hvem skal tvangsfjernes? Algoritmer udkonkurrerer i stigende grad menneskelige skøn i velfærdsstaten.

Det risikoscorede menneske

Af Brit Ross Winthereik, Professor, leder af Center for Digital Velfærd, IT-Universitetet, medlem af ATVs Digitale Vismandsråd

Kunstig intelligens ses som en gave til velfærdssamfundet, og det er håbet, at teknologien kan hjælpe til med at prioritere, hvem der skal hjælpes på statens regning. Men med teknologien følger også en fare for brud på basale rettigheder. Det vil både kunne ske, når borgere profileres som tilhørende en bestemt gruppe og tildeles en »risikoscore«, og i forbindelse med klager, hvor algoritmerne, der har hjulpet med at vurdere borgeren, ikke nemt kan stilles til ansvar for beslutninger.

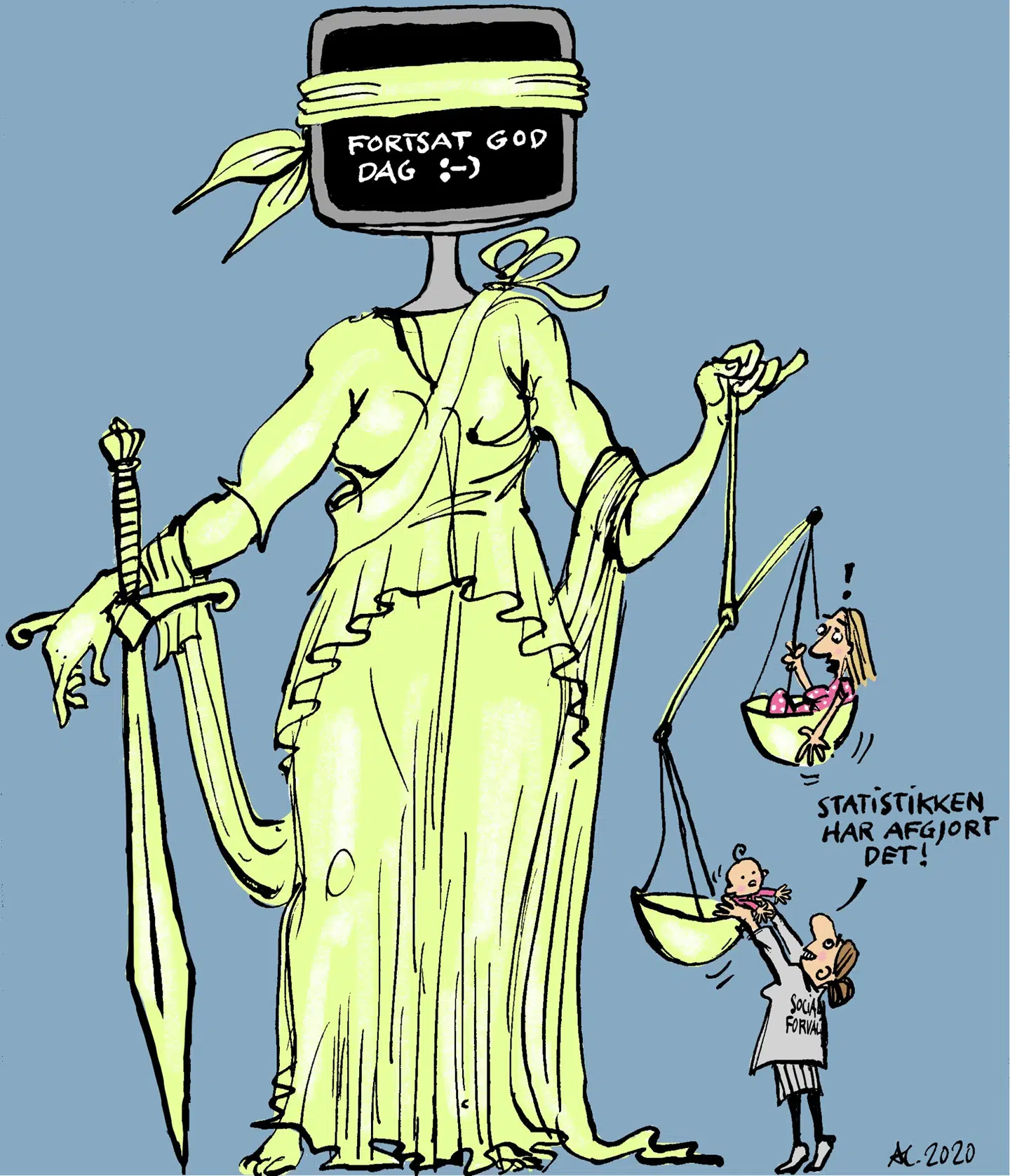

Digitalisering i form af datadrevet beslutningsstøtte spiller en større og større rolle i arbejdet med at prioritere forskellige typer behov. Hvis det kan sandsynliggøres, at en ledig i en bestemt kategori lettere vil komme i arbejde frem for en ledig i en anden kategori, prioriteres støtten efter vurderingen af deres arbejdsmarkedsparathed. Hvis det kan sandsynliggøres, at en tvangsfjernelse af et barn vil føre til en positiv udvikling for både barnet og de pårørende, prioriteres fjernelse af barnet over andre indsatser.

Hidtil har der været tale om fagpersoners afvejning af indikationer for det ene eller det andet udfald, men nu anvendes formelle metoder som statistik i stigende grad til at beregne sandsynligheder og opstille scenarier. Kommunerne arbejder intenst på at finde nye kilder til information om borgerne og på at udvikle metoder, der kan kvalificere troværdigheden af data og udregne en risikoscore. Der investeres massivt – både økonomisk og symbolsk – i den datadrevne kommunale forvaltning, simpelthen fordi det er et politisk ønske. For eksempel eksperimenterer kommuner og forskere i projektet Underretninger i fokus med at bruge nye datakilder til at lave detaljeret profilering af børn i sårbare familier.

Der findes endnu ikke meget viden om effekterne af kunstig intelligens i den kommunale forvaltning. Derfor er det vigtigt at sikre, at ethvert nyt digitaliseringstiltag understøtter basale borgerrettigheder, er åbent for eftersyn, og kan trækkes tilbage, hvis det ikke har den ønskede effekt. Det er muligt, at der er statistisk sandsynlighed for, at et barn til en tidligere straffet far også selv får en kriminel løbebane, eller at en ung med en funktionsnedsættelse har bedre odds, hvis vedkommende har forældre med en videregående uddannelse. Men når bestemte grupper automatisk kategoriseres og rangeres på baggrund af historiske datasæt, som er det, der sker, når man bruger kunstig intelligens, er der risiko for diskrimination. Den rettighed, der trues, er borgernes lighed for loven.

Kommunerne skal løse mange komplekse opgaver for færre penge. Det fremføres ofte, at digitale data er mere objektive end det erfarings- baserede, menneskelige skøn, og at tilstedeværelsen af flere datakilder vil kunne hjælpe med at effektivisere og forbedre kvaliteten af ydelserne. Der er imidlertid en risiko for, at basale borgerrettigheder overtrædes, når kommuner lader sig inspirere af private virksomheders forretningsmodeller. I den forbindelse er rapporten Tech-Giganterne, Ytringsfriheden og Privatlivet, udgivet af Institut for Menneskerettigheder i maj måned, inspirerende læsning. Rapporten handler om ytringsfrihed som eksempel på en basal rettighed, vi har som borgere, og peger på menneskerets- lige konsekvenser af tech-giganternes monopol på at kontrollere nyhedsstrømmen. Rapporten peger særligt på problemer ved algoritmisk defineret, det vil sige automatiseret, udvælgelse af opslag. Opslag sorteres ud fra en risikovurdering baseret på tidligere indsamlede informationer.

Det er på tide med en realistisk stillingtagen i forhold til de effekter, som automatisering af myndigheders beslutninger vil medføre. Det kræver både viden, holdning og handling. Jeg foreslår, at der sættes ind på følgende områder.

Uddannelse: Velfærd kan aldrig udelukkende eller primært være et computationelt anliggende, og derfor er det vigtigt, at fagpersoner i den kommunale forvaltning får udviklet deres ekspertise, i takt med at automatiserede systemer udvikles. For at sikre basale rettigheder for borgerne er det vigtigt, at velfærdsarbejde ikke redefineres som et computationelt problem, der kan løses med formelle metoder alene. Mennesker og maskiner kommer i stigende grad til at samarbejde omkring beslutninger, og fagpersoner og dataanalytikere skal sidde i førersædet i tæt dialog med eksperter.

Gennemsigtighed og mulighed for ansvarliggørelse af it-systemer, apps og platforme: Når beslutninger er fordelt mellem mennesker og maskiner – når skønnet og automatiseringen samarbejder – opstår behovet for, at ansvar kan placeres hos teknologien. Det skal være muligt at tilgå og forstå baggrunden for profileringen for på den måde at kunne gå automatiserede beslutninger om en selv eller ens pårørende efter i sømmene. Der findes ikke processer i dag, hvorigennem borgere kan gøre indsigelser mod en fejlagtig profilering og kategorisering, ud over gennem det almindelige klagesystem. Det bør være muligt både at kunne sagsøge platforme og systemer, hvis deres design og anvendelse medfører brud på sociale rettigheder, og at klage over selve profileringen.

Analoge rettigheder: I en velfærdssektor, hvor automatisering af beslutninger er ved at blive hverdag, er der behov for et opgør med forestillingen om borgeren som en, der naturligt er digital. Delvist-digitale, næsten-digitale og fuldt analoge borgeres rettigheder skal understøttes og tilgodeses. I den forbindelse bør det overvejes, hvordan en respektfuld behandling af de borgere, der ikke kan eller vil bruge digitale løsninger, kunne se ud.

Hvis vi ikke diskuterer digitale borgerrettigheder nu, risikerer vi en systematisk diskrimination af os alle baseret på data og processer, vi ikke kan forstå, og hvor ingen kan holdes til regnskab for beslutningen.

Retten til at være digital borger, uden at basale rettigheder krænkes, skal meget længere op på den politiske dagsorden, ligesom vi også skal diskutere grænserne for digitalisering.

Dette er en kronik og udtrykker derfor alene skribentens holdning. De kan indsende forslag til en kronik på opinion@weekendavisen.dk.